Interview de Jean-François Bonnefon concepteur du jeu Moral Machine pour donner une morale aux voitures autonomes

[ Lire plus… ]

Vous lisez LMC.today gratuitement. Ce travail de veille, de tri, d’analyse et de mise en cohérence existe grâce aux soutiens. Le soutien au projet ne coûte que quelques centimes par mois.

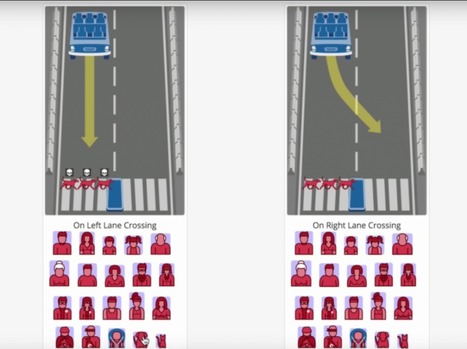

Ndlr : En réalité, le nombre d’accidents, à terme, sera si rare, que lorsqu’il s’en produira un on en fera un film. Tout simplement parce qu’il n’y a pas que la voiture elle-même qui entre en jeu, mais tout l’environnement. Imaginons un virage sans visibilité avec une classe d’écoliers derrière le virage, la voiture autonome saura AVANT d’entrer dans le virage, elle aura été avertie par l’environnement. Les panneaux de signalisation ainsi que les voitures échangeront en continu les données en toute transparence pour les occupants. Chaque véhicule sera informé en temps réel des conditions de la route, des encombrements, des piétons, des cyclistes, de la météo dans la zone où le véhicule se trouve. Le véhicule autonome aura les réflexes d’un ordinateur disposant d’un véhicule dont le freinage n’aura jamais été aussi abouti qu’aujourd’hui puisque c’est l’entité qui décidera du freinage qui commandera directement chaque roue. L’ordinateur embarqué sera donc un élément de sécurité active. Mais il y aura tous les paramètres de sécurité passive. Non seulement chaque véhicule sera averti des dangers, mais les autres usagers seront également avertis de l’arrivée du véhicule. L’interaction sera partout présente, tout le temps. Cela dit, j’ai beau être sensibilisé par le choix de protéger les enfants plutôt que les adultes, il n’en reste pas moins que ce choix est purement émotionnel et non rationnel. Un enfant ne vaut pas plus qu’un adulte. Cyniquement, un adulte peut remplacer un enfant, alors qu’un enfant a besoin des adultes. Il n’y a pas véritablement de vie qui vaut plus qu’une autre. Shooter 5 petits vieux pour sauver la vie de deux enfants me heurte largement autant que sauver trois enfants en tuant 4 adultes. Si le véhicule a le choix entre 4 enfants et 4 adultes, d’accord, ce n’est plus une question d’importance, mais de priorité à l’innocence que la morale impose. Mais sinon c’est le nombre de personnes qui doit déterminer, sans égards particulier en conséquence d’aucun paramètre. 18 adultes valent plus que 17 enfants, il y a un humain de plus, point. On peut prioriser la vie, on ne peut pas la hiérarchiser. On aura beau faire, il ne sera jamais possible de moraliser l’accident d’un véhicule autonome. C’est tout le problème. Le cerveau électronique de la machine travaille à vitesse informatique, la voiture ne sera pas comme un humain, elle aura systématiquement le temps de prendre une décision, quand l’humain, lui, réagit d’instinct. Seulement l’instinct humain est régit non seulement par les lois naturelles, mais également par sa culture sociale et par son code moral personnel. Ce qui fait qu’en présence d’une situation critique, il y a toute une foultitude de réactions diverses possibles selon qui conduit, ce qui rend l’accident ALEATOIRE et donc socialement acceptable et permet de le juger. En l’absence de cette diversité de réactions, face à une programmation qui unifiera le comportement de la voiture autonome, il n’y a plus lieu à justice, la mort était programmée, ce qui revient donc un meurtre, même si c’est pour éviter de tuer quelqu’un d’autre considéré « démocratiquement » comme moralement moins important, ce qui rend l’accident socialement moins acceptable puisque non aléatoire. Or, la définition même de l’accident, c’est l’aléatoire. Si c’est aléatoire, c’est un accident, si c’est programmé, c’est un homicide, parce que dans un accident avec un véhicule piloté, les victimes auraient eu une chance de survivre (et donc ce sont les autres qui auraient été victimes), alors que dans un véhicule autonome, on a fait exprès de les tuer, le véhicule a été programmé pour, il les a choisis, ne leur laissant aucune autre chance que celle de mourir, c’est donc bien un meurtre et même potentiellement un assassinat selon les circonstances.